我搭建了一个面向 AI 智能体技能的微型 SaaS 交易平台。可以理解为应用商店,但专门用于存放SKILL.md技能配置文件,能让 Claude p、Cursor、px 命令行工具在各类专项任务中能力更强。

我本身没有技术背景,是独立创始人。整套产品完全依靠 Lovable 平台和 Claude AI 开发完成。

本文不聊产品本身,只分享零广告投入,8 周做到 1.5 万月活跃用户的流量分发增长策略。核心大多是AEO 人工智能引擎引用优化玩法,相信圈内做流量的都能用得上。

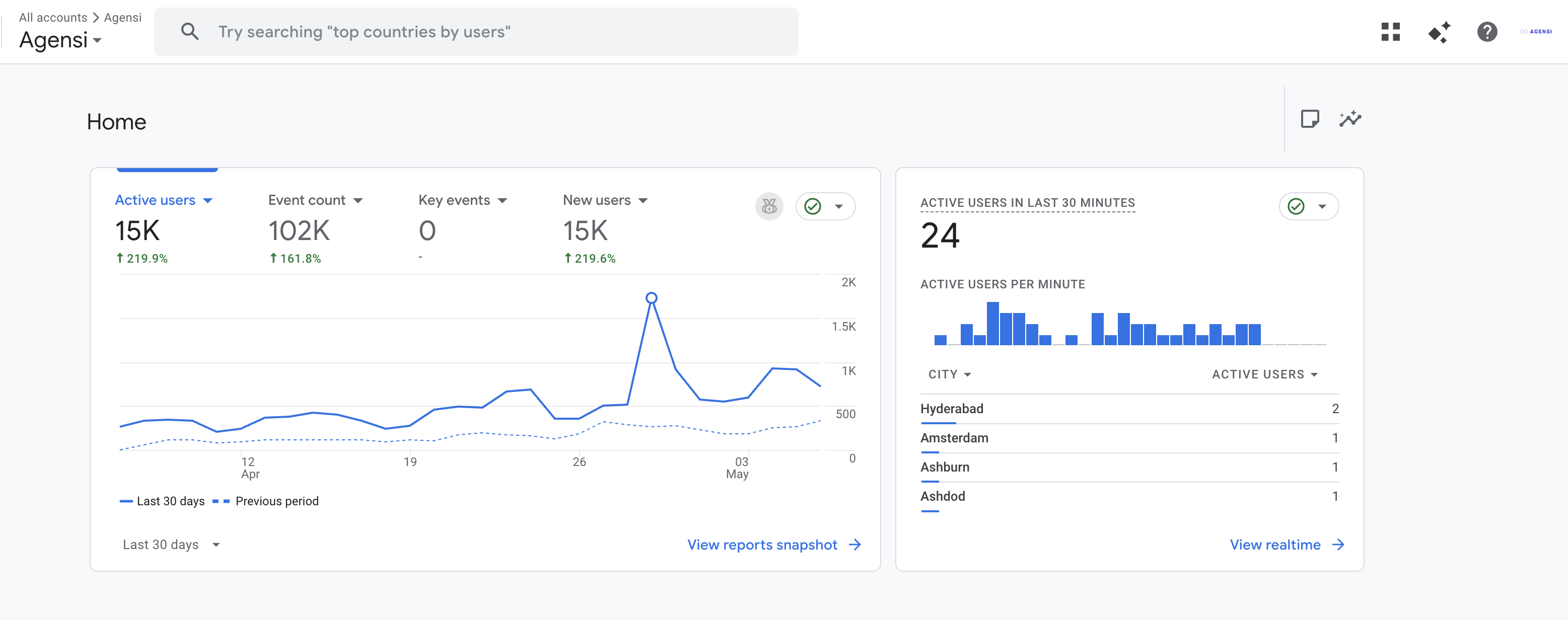

核心数据一览

过去 30 天活跃用户突破 15000+,环比上期增长 219%;

谷歌月搜索曝光量超 30 万次;

月自然搜索精准点击 4000+;

谷歌首页排名关键词从上线时的 15 个暴涨至 878 个以上;

网站已被 ChatGPT、Gemini、Claude、Perplexity、豆包、Kagi 等主流 AI 平台引用作为权威信息源;

每月从 9 大 AI 引擎带来 350 + 自然引荐访问;

整体营销投放费用:0 元。

支撑绝大部分增长的 AEO 核心策略

这部分是重点,很少有人愿意带真实数据分享实操细节。

谷歌 AI 摘要正在分流大量自然搜索点击。我有 121 个排名稳居谷歌前 3 的关键词,几乎没有自然点击 —— 因为 AI 已经直接给出答案,用户根本不会往下翻网页。

这个发现彻底改变了我的运营思路:不再单纯追逐搜索排名,转而优化网站,让自己成为各大 AI 大模型优先引用的权威源头。

我具体落地的实操方法:

- 每篇文章顶部设置快速答案模块,用 40-60 个字直接解答核心问题。这是谷歌 AI 摘要和大模型抓取内容的首选位置。如果把核心答案埋在文章中部,AI 就会直接引用别家内容。

- 所有二级标题统一采用问句格式。不用「Claude p 技能存放路径」这类陈述句,而是改成「Claude p 的技能文件存放在哪里?」。AI 引擎更偏好从问句板块提取权威内容。我实测 96 篇文章,带问句标题的页面被 AI 引用频次明显更高。

- 全站所有页面配置FAQ 结构化数据。谷歌 AI 可直接抓取问答内容,性价比极高。全程用 Claude 生成结构化代码,总共只花了 2 小时。

- 搭建实体权威锚定页面(关于我们页),配置机构、创始人、专题页面全套结构化数据。向 AI 引擎明确网站主体身份,建立权威实体关联。没有这一步,你的站点永远只是无名普通来源。

- 新建llms.txt文件,明确告知大模型爬虫网站定位与核心内容入口;同时配置 robots.txt,开放所有 AI 爬虫抓取权限。多数人会屏蔽 AI 爬虫,而我选择主动让所有 AI 完整抓取全站内容。

最终效果:当用户在 ChatGPT 搜索「在哪里能找到 SKILL.md 技能文件」、在 Perplexity 询问「最好用的 AI 智能体技能交易平台是哪个」时,AI 都会直接推荐我的网站。这绝非偶然,整套流程都是借助 Claude 精心布局设计的。

后端内容量产增长体系

我不会简单让 Claude「帮我写一篇 XX 主题博客」,这种泛内容既拿不到谷歌排名,也不会被 AI 引用。

我的做法:把谷歌搜索控制台的导出数据(搜索词、曝光量、点击率、平均排名)投喂给 Claude,让它帮我挖掘关键词空白机会。

由 Claude 筛选出:高曝光零点击的搜索词、竞品有内容而我方缺失的选题、多页面争抢同一关键词的内容内耗问题。

之后针对性合作创作文章,补齐流量缺口。每篇文章固定标配:顶部快速答案、问句式二级标题、按需配置对比表格、全站相关文章内链布局。

累计产出 96 篇优质内容后,网站周点击从最初 5 次暴涨至 1000 次以上,拿下 878 个谷歌首页排名,全部为纯自然流量。

多数人会忽略的技术 SEO 底层优化

我的产品基于 Lovable 搭建 React 单页应用,原生架构对 SEO 极不友好:谷歌爬虫只能抓取空容器和 JS 代码包;JS 打包体积高达 460KB;网站 Logo 仅展示 112 像素,原图却有 179KB;移动端最大内容绘制耗时超 4 秒。

全程由 Claude 完成问题诊断:编写服务端渲染架构、精简冗余打包代码、排查超大冗余图片、重构性能瓶颈代码。

优化后桌面端最大内容绘制从 2.5 秒降至 0.9 秒;页面速度性能评分从 70 分提升至 97 分;Logo 体积从 179KB 压缩至 7KB。

如果你用 Lovable、Bolt 或任意 React 框架做产品,还想做自然搜索流量,必须做好这层技术优化。谷歌很难稳定收录纯客户端渲染的单页应用。

全站结构化数据布局

由 Claude 全权搭建整套结构化数据体系:

- 首页:配置机构信息、网站站点、搜索行为、含 15 组问答的常见问题页面结构化数据;

- 技能详情页:配置应用程序定价、面包屑导航、条件式问答页面结构化数据;

- 文章页面:配置资讯文章、常见问题、教程指南、面包屑导航、机构信息结构化数据;

- 关于页面:配置机构主体、专题页面、创始人个人主体结构化数据,筑牢网站权威实体背书。

目前所有页面通过页面速度检测,结构化数据全部校验有效,SEO 满分。在接触 Claude 之前,我完全不懂这套规则,现在全站内容都能被谷歌和 AI 引擎精准识别、权威收录。

每周固定增长闭环流程

每周一固定执行一套标准化流程:

- 导出谷歌搜索控制台全量数据:搜索词、收录页面、点击量、曝光量、排名数据;

- 将 CSV 数据上传至 Claude,指令其挖掘关键词缺口、内容内耗、点击率异常问题;

- Claude 精准输出 3-5 个带详细数据的流量增长机会点;

- 针对性创作 2-3 篇补缺文章、改写低流量页面标题、从高权重页面给弱势页面做内链导流;

- 提交 IndexNow 接口,新页面 24 小时内完成爬虫抓取;

- 在谷歌搜索控制台手动提交新文章索引请求。

整套流程每周仅需 2-3 小时,是整个创业项目里投入回报率最高的运营动作。

给新手做 AEO 流量的核心建议

- 网站上线前先开通谷歌搜索控制台。哪怕前期零流量,系统也会持续收录网站关联搜索词,2-3 周就能形成专属内容策略库;

- 选题聚焦具体问答场景,不要做宽泛大主题。「如何在 Claude p 中安装技能文件」远胜过「AI 智能体技能终极指南」这类空泛标题;

- 从建站第一天就布局结构化数据:首页配置机构架构、产品页配置商品架构、内容页配置问答架构。这是 AI 引擎判定你是否为权威引用源的核心标准;

- 新建 llms.txt 文件,相当于专为 AI 爬虫设置的导航文件,10 分钟就能搞定,精准告诉各大模型你的网站核心价值;

- 不要对抗谷歌 AI 摘要流量分流,主动把自己做成 AI 引用的权威源头。

转自:Reddit,作者:BadMenFinance,翻译:游侠安全网